Hay consenso por parte de los gurús y expertos en tecnología en que este año será un punto de inflexión en cuanto a la implantación y uso de la inteligencia artificial. La IA invade todas las capas que podamos imaginar y hay cierto miedo en cuanto a los objetivos que tienen algunos con ella. Una de las innovaciones más impactantes y a la vez preocupantes es el desarrollo de los «deepfakes«.

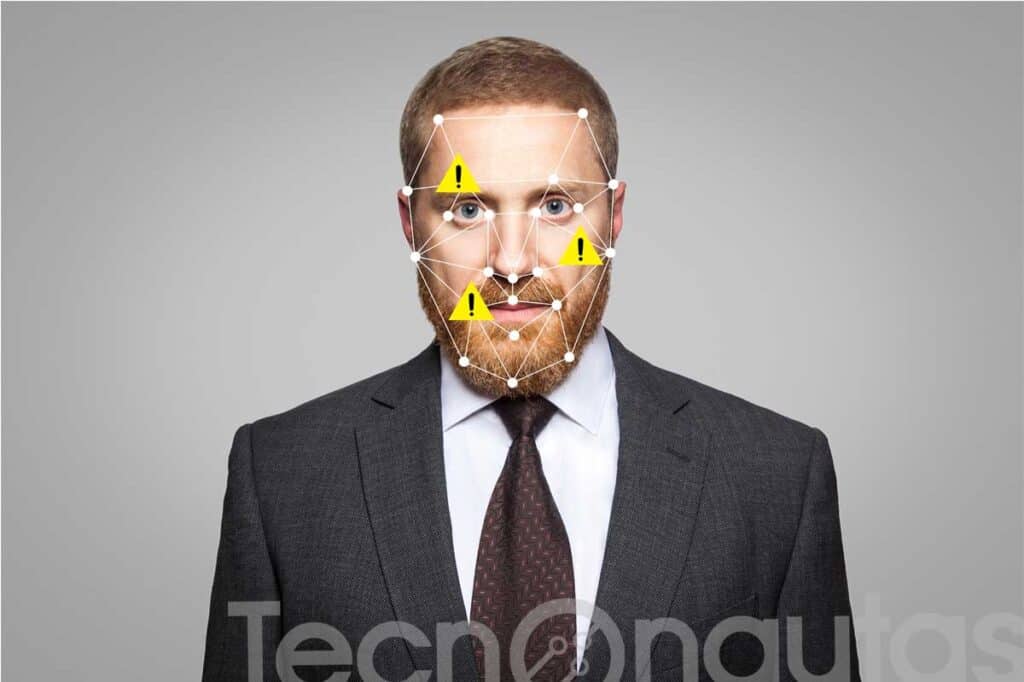

Estas son manipulaciones digitales que utilizan inteligencia artificial para crear contenido audiovisual falso, generalmente mediante la sustitución del rostro o la voz de una persona por la de otra, con resultados sorprendentemente realistas. Aunque esta tecnología puede tener aplicaciones creativas y divertidas, también plantea una serie de desafíos éticos, legales y sociales que requieren una reflexión profunda.

¿Qué es y de donde proceden los deepfakes?

El término «deepfake» surge de la combinación de «deep learning» (aprendizaje profundo) y «fake» (falso). La tecnología deep learning, una rama del aprendizaje automático basada en redes neuronales artificiales, es fundamental para la creación de estos videos manipulados. Los deepfakes se popularizaron a través de las redes sociales y plataformas de video online, donde se utilizan para crear contenido humorístico, parodias e incluso videos de entretenimiento.

Aunque los deepfakes pueden parecer inofensivos en su uso recreativo, plantean serias preocupaciones éticas y sociales. Por un lado, pueden ser utilizados para difamar, extorsionar o difundir desinformación, comprometiendo la reputación y la privacidad de las personas. Por otro lado, también pueden ser utilizados con fines políticos para manipular la opinión pública o generar discordia social.

Desafíos legales y de seguridad

La proliferación de deepfakes plantea desafíos legales y de seguridad significativos. ¿Quién es responsable cuando se crea y distribuye contenido deepfake que daña la reputación de alguien? ¿Cómo se puede verificar la autenticidad de los videos en un mundo donde la tecnología permite la manipulación digital perfecta? Estas son preguntas complejas que desafían los marcos legales y las normativas existentes.

Ante la creciente preocupación por los deepfakes, diversas instituciones y empresas están trabajando en soluciones para detectar y mitigar su impacto. Esto incluye el desarrollo de algoritmos de detección de deepfakes, la promoción de la alfabetización mediática para ayudar a las personas a reconocer contenido manipulado y la implementación de políticas y regulaciones para abordar el uso malicioso de esta tecnología.

El futuro de los deepfakes

A medida que la tecnología deepfake continúa evolucionando, es probable que surjan nuevas aplicaciones y desafíos. Es importante que la sociedad esté preparada para enfrentar estos cambios y trabajar hacia un uso ético y responsable de la tecnología. Esto requerirá una combinación de regulación, educación pública y avances tecnológicos para garantizar que los deepfakes no se conviertan en una amenaza para la confianza y la integridad en el mundo digital.

¿Puede influir esta IA en las elecciones de Estados Unidos?

Vinculado este tipo de desarrollo tecnológico con la actualidad, hay que destacar que distintos expertos han mostrado cierta preocupación sobre el posible impacto que pueden tener contenidos deepfake en las próximas elecciones de Estados Unidos. La primera potencia mundial se prepara para una cita en la que los ciberriesgos están a la orden del día.

Check Point® Software Technologies Ltd., líder en soluciones de ciberseguridad basadas en IA para entornos en la nube, ha realizado un análisis exhaustivo sobre el funcionamiento de la tecnología deepfake y las múltiples capas de este submundo digital, con el fin de alertar sobre el aumento en la disponibilidad de estos servicios en la Darknet a través de la plataforma Telegram. Se ha visto que en estos espacios existe contenido audiovisual falso y altamente realista, diseñado para confundir a la opinión pública o desacreditar a figuras políticas.

De forma concreta, en plataformas como GitHub, se han identificado más de 3.000 repositorios relacionados con la tecnología deepfake, lo que indica su amplio desarrollo y el potencial de su distribución. Por otro lado, Telegram cuenta con más de 400 canales y grupos dedicados a ofrecer servicios de deepfake, que van desde bots automatizados que guían a los usuarios en el proceso, hasta servicios personalizados.

Los especialistas subrayan que el acceso a estos servicios es muy sencillo y, al mismo tiempo, muy económico, ya que por un mínimo de 2 dólares se puede crear un contenido deepfake. Una de las tácticas más frecuentemente utilizadas con la tecnología deepfake es la clonación de voces, la cual permite replicarlas con una precisión extraordinaria. Esta técnica resulta más sencilla de producir y de compartir que los deepfakes de vídeo, y es notablemente efectiva para difundir desinformación.

A principios de este año, se divulgó una llamada automatizada en la que se escuchaba la voz falsa de Joe Biden, actual presidente de los Estados Unidos y candidato a la reelección, instando a los residentes de New Hampshire a no votar. Esta acción generó preocupación y reflexión sobre el impacto de la manipulación digital en los procesos electorales. Como respuesta, Estados Unidos ha prohibido las llamadas automáticas generadas por inteligencia artificial, reflejando así la creciente preocupación por el potencial de la manipulación digital para influir en las elecciones y socavar la integridad del proceso democrático.